Justiça condena iFood a indenizar entregador do DF por danos morais após 'falha racista' em reconhecimento facial; entenda

Precisa de se destacar nas redes sociais.

Conheça nossos planos de gestão de mídias sociais a partir de R$590,00 mês. Entre em contato

BID Mídia Patrocinado

Aplicativo deixou de reconhecer rosto do entregador após mudança de penteado, diz defesa; indenização foi fixada em R$ 60 mil. O iFood afirmou não existe análise de características raciais no procedimento de reconhecimento facial. A 22ª Vara do Trabalho de Brasília condenou o iFood a pagar R$ 60 mil para entregador.

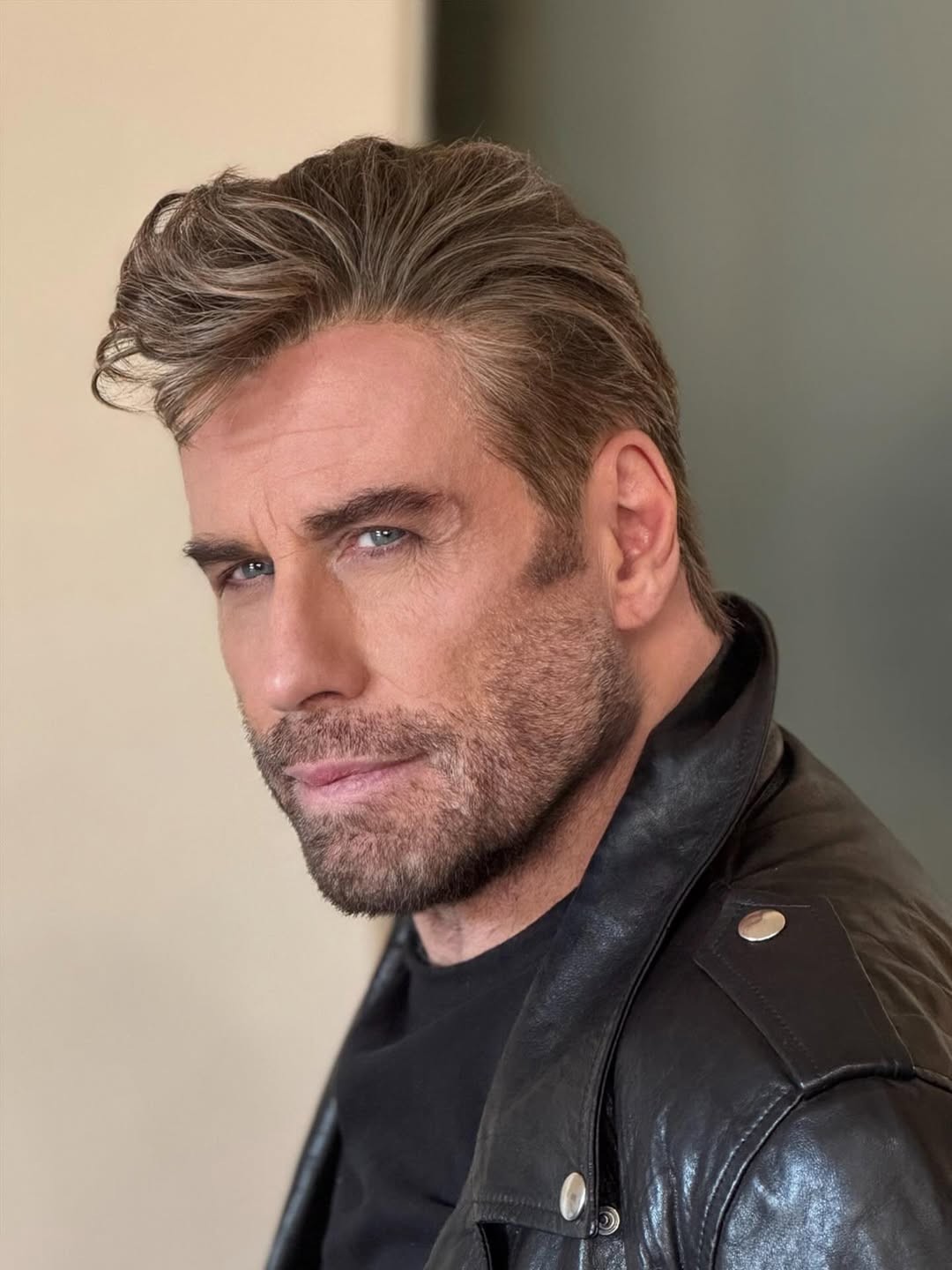

Celso Tavares/G1

A 22ª Vara do Trabalho de Brasília condenou o iFood a pagar R$ 60 mil como indenização por danos morais ao entregador Tiago Alves – que é um homem negro e acusa a plataforma de ter cometido uma "falha racista" no sistema de reconhecimento facial utilizado pelo app. Cabe recurso da decisão.

✅ Clique aqui para seguir o canal do g1 DF no WhatsApp.

À TV Globo, o iFood afirmou não existe análise de características raciais no procedimento de reconhecimento facial e que que vai recorrer à decisão (veja nota completa abaixo).

O aplicativo do iFood exige que, todos os dias, os entregadores enviem uma foto como reconhecimento facial, antes das entregas ou durante o trabalho. O objetivo é evitar fraudes e invasão à conta.

Tiago Alves diz que estava acostumado a fazer o procedimento – mas, um dia, foi bloqueado pela plataforma. Em contato com o suporte, foi informado que havia outra pessoa usando a conta.

A equipe de atendimento digital chegou a enviar as fotos do suposto farsante. E aí, a surpresa: eram as fotos do próprio Tiago. Confira na imagem anexada ao processo:

Reconhecimento facial enviado por Tiago Alves ao iFood; à direita, outra foto do entregador

Arquivo pessoal/Reprodução

“No dia do bloqueio, saí de casa com uma meta a ser batida, todo motoboy faz isso, R$ 100 no dia. Liguei o app, pediram o reconhecimento facial e fui para a luta. [...] No caminho, veio a mensagem de que eu estava bloqueado por quebrar as regras de uso do app", lembra Tiago.

Inconformado com o bloqueio, o entregador recorreu no próprio aplicativo e pediu uma explicação ao iFood.

"No dia seguinte, responderam que outra pessoa tentou acessar o meu app. Pedi que enviassem a foto de quem estava tentando acessar. E para minha surpresa, a pessoa na foto era eu.”

Mensagem do iFood informando cancelamento de conta de entregador negro do DF por 'problemas graves' com reconhecimento facial

Arquivo pessoal/Reprodução

Juiz vê 'falha racista'

Na sentença, o juiz trabalhista Charbel Chater considerou que a conduta da iFood.com Agência de Restaurantes Online S.A violou a dignidade humana do trabalhador. E reconheceu a falha como racista.

A única diferença entre a foto do cadastro e a aparência atual de Tiago era o cabelo black, que ele estava deixando crescer.

“Desse modo, reconheço como verdadeiros: a suspensão do contrato de trabalho por culpa exclusiva da Reclamada; os prejuízos financeiros e psicológicos sofridos pelo Reclamante em razão da impossibilidade de laborar em favor da Reclamada; e a falha racista na ferramenta utilizada para reconhecimento facial”, diz a decisão.

Tiago diz que se sentiu rejeitado pela plataforma, e que a princípio não percebeu se tratar de um caso de racismo.

"Tentei inúmeras vezes explicar o ocorrido. O retorno que tive foi que, infelizmente, não tinha o que fazer", relata.

"No começo não [percebi], depois fiquei analisando. No dia que procurei a advogada, eu descobri sobre racismo algoritmo. Fiquei bastante triste, me tiraram uma renda bem significativa, contava com esse dinheiro toda semana pra pagar minhas contas, aí por um erro e por racismo me bloquearam. Depois, a tristeza virou ódio.”

Na primeira audiência convocada para julgar o caso, o iFood não cumpriu o prazo para apresentar a defesa.

Por isso, o juiz aplicou a chamada "confissão ficta" – quando as alegações de uma parte são tratadas como verdadeiras devido à ausência de contestação.

Durante o processo, o iFood liberou a conta do Tiago – que voltou a trabalhar com entrega pelo app.

Racismo algoritmico: pesquisadora estuda tema que surge com avanço da IA

Como um algoritmo pode ser racista?

O Doutor Benedito Cerezzo, professor de direito processual civil e prática jurídica na Faculdade de Direito da Universidade de Brasília explica.

"A resposta, por incrível que pareça, é simples: é que quem prepara, quem organiza, quem cria a inteligência artificial é a pessoa branca. E ela, portanto, ao fazer isso, joga nesse sistema todo seu preconceito. Inclusive em ambientes que são frequentados pela maioria negra”.

Benedito reforça que o algoritmo é pensado para as pessoas brancas em um contexto negro. “É preparado por pessoas brancas para serem aplicadas pela população. Mas temos a maioria da população negra. Para nós negros, é muito dificil ter uma sociedade que não nos enxerga enquanto pertencente desse quadro.”

A defesa de Tiago baseou-se neste argumento na petição inicial do caso.

“A conduta discriminatória da reclamada, além da ausência de mecanismos efetivos para combate ao racismo algorítmico, que segue se perpetuando, ofende aos princípios da dignidade humana, da valorização social do trabalho e livre iniciativa, do trabalho e da renda básica.”, escreveram os advogados.

Brasileiros treinam inteligência artificial para abordar temas como racismo e nazismo

A Associação de Motofretistas e Entregadores Autônomos do Distrito Federal costuma encaminhar casos semelhantes ao de Tiago para Luara Dias, que atuou na defesa do entregador.

Ela explica que casos como o de Tiago não são incomuns. E avalia o sistema do iFood como racista.

“O que observamos, ao atender os entregadores, é que a maior parte deles chegavam com o mesmo problema: haviam sido banidos após tentar realizar o reconhecimento facial e a plataforma não os reconhecer, acusando-os de estarem emprestando conta.O que podemos concluir é que existem falhas no mecanismo de reconhecimento facial, que envolvem também a falta de uma postura antirracista”, diz.

Segundo a defesa de Tiago, o reconhecimento do caso pela Justiça como uma "falha racista", e não como simples problema do sistema, é uma novidade.

“É uma vitória muito importante e espero que sirva para que as empresas que programam ou utilizam sistemas de reconhecimento facial assumam um verdadeiro compromisso antirracista, já que não são casos isolados, mas infelizmente, reiterados. Ou seja, é uma vitória muito importante por seu caráter pedagógico, na medida em que mostra a existência de um erro grave que precisa ser corrigido com adequação e urgência.”

O que diz o Ifood

"O iFood não tolera casos de discriminação em seu ecossistema, seja por parte de clientes, entregadores ou estabelecimentos. Dentro desta premissa, oferece a todos os entregadores parceiros suporte psicológico e jurídico gratuito em caso de discriminação, agressão física, ameaça e violência sexual. A empresa também possui uma política antidiscriminatória e, recentemente, anunciou sua ampliação, reforçando o compromisso com um ambiente mais seguro e ético para entregadores, estabelecimentos parceiros, clientes e operadores logísticos. No primeiro ano de vigência desta política, foram recebidas mais de 19 mil denúncias válidas, com 90% delas resultando em sanções.

É importante reforçar que a verificação da identidade com o reconhecimento facial é necessária para a segurança dos entregadores parceiros e dos nossos serviços. Este procedimento é autorizado pela Lei Geral de Proteção de Dados Pessoais para prevenir fraudes e garantir a segurança do titular de dados durante o processo de identificação e autenticação. Estes dados são tratados exclusivamente para esta finalidade e o iFood reforça inexistir qualquer análise de características raciais no procedimento de reconhecimento facial.

A decisão proferida não é definitiva e o iFood irá recorrer para poder esclarecer os fatos alegados na ação. A empresa reafirma o seu compromisso com a equidade racial e repudia todo e qualquer ato discriminatório."

?️ Veja reportagem sobre inteligência artificial:

Inteligência Artificial: o risco do viés algorítmico

Leia mais notícias sobre a região no g1 DF.

Celso Tavares/G1

A 22ª Vara do Trabalho de Brasília condenou o iFood a pagar R$ 60 mil como indenização por danos morais ao entregador Tiago Alves – que é um homem negro e acusa a plataforma de ter cometido uma "falha racista" no sistema de reconhecimento facial utilizado pelo app. Cabe recurso da decisão.

✅ Clique aqui para seguir o canal do g1 DF no WhatsApp.

À TV Globo, o iFood afirmou não existe análise de características raciais no procedimento de reconhecimento facial e que que vai recorrer à decisão (veja nota completa abaixo).

O aplicativo do iFood exige que, todos os dias, os entregadores enviem uma foto como reconhecimento facial, antes das entregas ou durante o trabalho. O objetivo é evitar fraudes e invasão à conta.

Tiago Alves diz que estava acostumado a fazer o procedimento – mas, um dia, foi bloqueado pela plataforma. Em contato com o suporte, foi informado que havia outra pessoa usando a conta.

A equipe de atendimento digital chegou a enviar as fotos do suposto farsante. E aí, a surpresa: eram as fotos do próprio Tiago. Confira na imagem anexada ao processo:

Reconhecimento facial enviado por Tiago Alves ao iFood; à direita, outra foto do entregador

Arquivo pessoal/Reprodução

“No dia do bloqueio, saí de casa com uma meta a ser batida, todo motoboy faz isso, R$ 100 no dia. Liguei o app, pediram o reconhecimento facial e fui para a luta. [...] No caminho, veio a mensagem de que eu estava bloqueado por quebrar as regras de uso do app", lembra Tiago.

Inconformado com o bloqueio, o entregador recorreu no próprio aplicativo e pediu uma explicação ao iFood.

"No dia seguinte, responderam que outra pessoa tentou acessar o meu app. Pedi que enviassem a foto de quem estava tentando acessar. E para minha surpresa, a pessoa na foto era eu.”

Mensagem do iFood informando cancelamento de conta de entregador negro do DF por 'problemas graves' com reconhecimento facial

Arquivo pessoal/Reprodução

Juiz vê 'falha racista'

Na sentença, o juiz trabalhista Charbel Chater considerou que a conduta da iFood.com Agência de Restaurantes Online S.A violou a dignidade humana do trabalhador. E reconheceu a falha como racista.

A única diferença entre a foto do cadastro e a aparência atual de Tiago era o cabelo black, que ele estava deixando crescer.

“Desse modo, reconheço como verdadeiros: a suspensão do contrato de trabalho por culpa exclusiva da Reclamada; os prejuízos financeiros e psicológicos sofridos pelo Reclamante em razão da impossibilidade de laborar em favor da Reclamada; e a falha racista na ferramenta utilizada para reconhecimento facial”, diz a decisão.

Tiago diz que se sentiu rejeitado pela plataforma, e que a princípio não percebeu se tratar de um caso de racismo.

"Tentei inúmeras vezes explicar o ocorrido. O retorno que tive foi que, infelizmente, não tinha o que fazer", relata.

"No começo não [percebi], depois fiquei analisando. No dia que procurei a advogada, eu descobri sobre racismo algoritmo. Fiquei bastante triste, me tiraram uma renda bem significativa, contava com esse dinheiro toda semana pra pagar minhas contas, aí por um erro e por racismo me bloquearam. Depois, a tristeza virou ódio.”

Na primeira audiência convocada para julgar o caso, o iFood não cumpriu o prazo para apresentar a defesa.

Por isso, o juiz aplicou a chamada "confissão ficta" – quando as alegações de uma parte são tratadas como verdadeiras devido à ausência de contestação.

Durante o processo, o iFood liberou a conta do Tiago – que voltou a trabalhar com entrega pelo app.

Racismo algoritmico: pesquisadora estuda tema que surge com avanço da IA

Como um algoritmo pode ser racista?

O Doutor Benedito Cerezzo, professor de direito processual civil e prática jurídica na Faculdade de Direito da Universidade de Brasília explica.

"A resposta, por incrível que pareça, é simples: é que quem prepara, quem organiza, quem cria a inteligência artificial é a pessoa branca. E ela, portanto, ao fazer isso, joga nesse sistema todo seu preconceito. Inclusive em ambientes que são frequentados pela maioria negra”.

Benedito reforça que o algoritmo é pensado para as pessoas brancas em um contexto negro. “É preparado por pessoas brancas para serem aplicadas pela população. Mas temos a maioria da população negra. Para nós negros, é muito dificil ter uma sociedade que não nos enxerga enquanto pertencente desse quadro.”

A defesa de Tiago baseou-se neste argumento na petição inicial do caso.

“A conduta discriminatória da reclamada, além da ausência de mecanismos efetivos para combate ao racismo algorítmico, que segue se perpetuando, ofende aos princípios da dignidade humana, da valorização social do trabalho e livre iniciativa, do trabalho e da renda básica.”, escreveram os advogados.

Brasileiros treinam inteligência artificial para abordar temas como racismo e nazismo

A Associação de Motofretistas e Entregadores Autônomos do Distrito Federal costuma encaminhar casos semelhantes ao de Tiago para Luara Dias, que atuou na defesa do entregador.

Ela explica que casos como o de Tiago não são incomuns. E avalia o sistema do iFood como racista.

“O que observamos, ao atender os entregadores, é que a maior parte deles chegavam com o mesmo problema: haviam sido banidos após tentar realizar o reconhecimento facial e a plataforma não os reconhecer, acusando-os de estarem emprestando conta.O que podemos concluir é que existem falhas no mecanismo de reconhecimento facial, que envolvem também a falta de uma postura antirracista”, diz.

Segundo a defesa de Tiago, o reconhecimento do caso pela Justiça como uma "falha racista", e não como simples problema do sistema, é uma novidade.

“É uma vitória muito importante e espero que sirva para que as empresas que programam ou utilizam sistemas de reconhecimento facial assumam um verdadeiro compromisso antirracista, já que não são casos isolados, mas infelizmente, reiterados. Ou seja, é uma vitória muito importante por seu caráter pedagógico, na medida em que mostra a existência de um erro grave que precisa ser corrigido com adequação e urgência.”

O que diz o Ifood

"O iFood não tolera casos de discriminação em seu ecossistema, seja por parte de clientes, entregadores ou estabelecimentos. Dentro desta premissa, oferece a todos os entregadores parceiros suporte psicológico e jurídico gratuito em caso de discriminação, agressão física, ameaça e violência sexual. A empresa também possui uma política antidiscriminatória e, recentemente, anunciou sua ampliação, reforçando o compromisso com um ambiente mais seguro e ético para entregadores, estabelecimentos parceiros, clientes e operadores logísticos. No primeiro ano de vigência desta política, foram recebidas mais de 19 mil denúncias válidas, com 90% delas resultando em sanções.

É importante reforçar que a verificação da identidade com o reconhecimento facial é necessária para a segurança dos entregadores parceiros e dos nossos serviços. Este procedimento é autorizado pela Lei Geral de Proteção de Dados Pessoais para prevenir fraudes e garantir a segurança do titular de dados durante o processo de identificação e autenticação. Estes dados são tratados exclusivamente para esta finalidade e o iFood reforça inexistir qualquer análise de características raciais no procedimento de reconhecimento facial.

A decisão proferida não é definitiva e o iFood irá recorrer para poder esclarecer os fatos alegados na ação. A empresa reafirma o seu compromisso com a equidade racial e repudia todo e qualquer ato discriminatório."

?️ Veja reportagem sobre inteligência artificial:

Inteligência Artificial: o risco do viés algorítmico

Leia mais notícias sobre a região no g1 DF.

Para ler a notícia completa, acesse o link original:

0 curtidas

Notícias Relacionadas

Não há mais notícias para carregar

Comentários 0